Amazon SageMaker HyperPod 功能

在数千个 AI 加速器上扩展和加速生成式人工智能模型的开发

任务治理

借助 Amazon SageMaker HyperPod,您可以全面了解并控制生成式人工智能模型开发任务(例如训练和推理)中的计算资源分配。SageMaker HyperPod 可自动管理任务队列,确保最关键的任务得到优先处理,同时可以更有效地使用计算资源来降低模型开发成本。 只需几个简单的步骤,管理员就可以为不同的任务定义优先级,并设置每个团队或项目可以使用的计算资源数量限制。 然后,数据科学家和开发人员会创建任务(例如训练运行、微调特定模型或对经过训练的模型进行预测),SageMaker HyperPod 则会根据管理员设置的计算资源限制和优先级自动运行这些任务。当有高优先级任务需要完成但所有计算资源都在使用中时,SageMaker HyperPod 会自动从优先级较低的任务中释放计算资源。 此外,SageMaker HyperPod 还会自动使用闲置计算资源来加速等待中的任务。SageMaker HyperPod 提供了一个控制面板,管理员可以在其中监控和审核正在运行或等待计算资源的任务。

灵活的训练计划

为了满足您的训练时间表和预算,SageMaker HyperPod 可帮助您制定最经济高效的训练计划,这些计划可使用来自多个计算容量块的计算资源。批准这些训练计划后,SageMaker HyperPod 就会自动配置基础设施,并在这些计算资源上运行训练作业,而不需要任何手动干预。您可以节省数周管理训练流程的工作,从而使作业与计算可用性保持一致。

定制模型的优化方案

SageMaker HyperPod 方案可帮助各种技能水平的数据科学家和开发人员从最先进的性能中获益,同时可以快速开始训练和微调公开可用的生成式人工智能模型,包括 Llama、Mixtral、Mistral 和 DeepSeek 模型。此外,您还可以利用一系列技术对 Amazon Nova 基础模型(包括 Nova Micro、Nova Lite 和 Nova Pro)进行定制,这些技术包括监督式微调 (SFT)、知识蒸馏、直接偏好优化 (DPO)、近端策略优化以及持续预训练,并支持在 SFT、蒸馏和 DPO 过程中选择参数高效或完整模型训练方式。每个配方都包含一个已经过 AWS 测试的训练堆栈,从而避免了花费数周时间来测试不同模型配置的繁琐工作。您可以通过更改单行配方在基于 GPU 和基于 AWS Trainium 的实例之间进行切换,启用自动模型检查点以提高训练灵活性,并在 SageMaker HyperPod 上运行生产工作负载。

高性能分布式训练

通过在 AWS 加速器中自动拆分模型和训练数据集,SageMaker HyperPod 可加速分布式训练。它可以帮助您优化针对 AWS 网络基础设施和集群拓扑的训练任务,并通过优化存储检查点的频率来简化模型检查点,从而确保训练期间的开销最小。

高级可观测性和实验工具

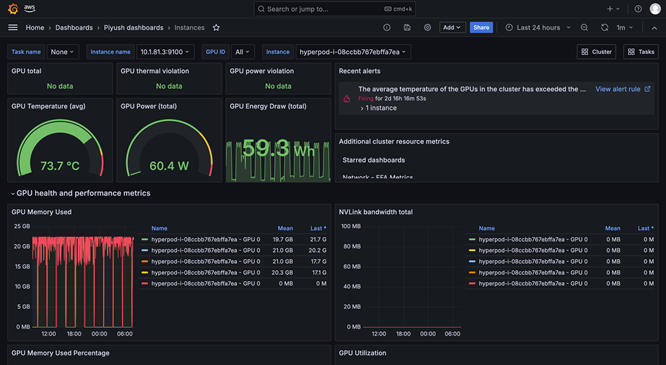

SageMaker HyperPod 的可观测性功能提供了预配置在 Amazon Managed Grafana 中的统一控制面板,其监测数据会自动发布到 Amazon Managed Prometheus 工作区中。您可以在一个视图中查看实时性能指标、资源使用情况和集群运行状况,从而使团队能够迅速发现瓶颈、避免代价高昂的延误,并优化计算资源。HyperPod 还与 Amazon CloudWatch Container Insights 相集成,以便您更深入地了解集群的性能、运行状况和使用情况。SageMaker 中托管的 TensorBoard 通过可视化模型架构来识别和修复整合问题,从而帮助您缩短开发时间。SageMaker 中托管的 MLflow 可帮助您高效地大规模管理实验。

工作负载调度和编排

SageMaker HyperPod 用户界面可以使用 Slurm 或 Amazon Elastic Kubernetes Service(Amazon EKS)进行高度自定义。您可以选择并安装任何需要的框架或工具。所有集群均使用您选择的实例类型和数量进行预调配,并保留供您在各种工作负载中使用。借助 SageMaker HyperPod 中的 Amazon EKS 支持,您可以通过一致的基于 Kubernetes 的管理员体验来管理和操作集群。从训练、微调到推理,高效运行和扩展工作负载。您也可以共享计算容量,并在 Slurm 和 Amazon EKS 之间切换以处理不同类型的工作负载。

自动集群运行状况检查和修复

如果在模型开发工作负载期间有任何实例出现缺陷,SageMaker HyperPod 会自动进行检测并解决基础设施问题。为了检测硬件故障,SageMaker HyperPod 会定期对加速器和网络完整性进行一系列运行状况检查。

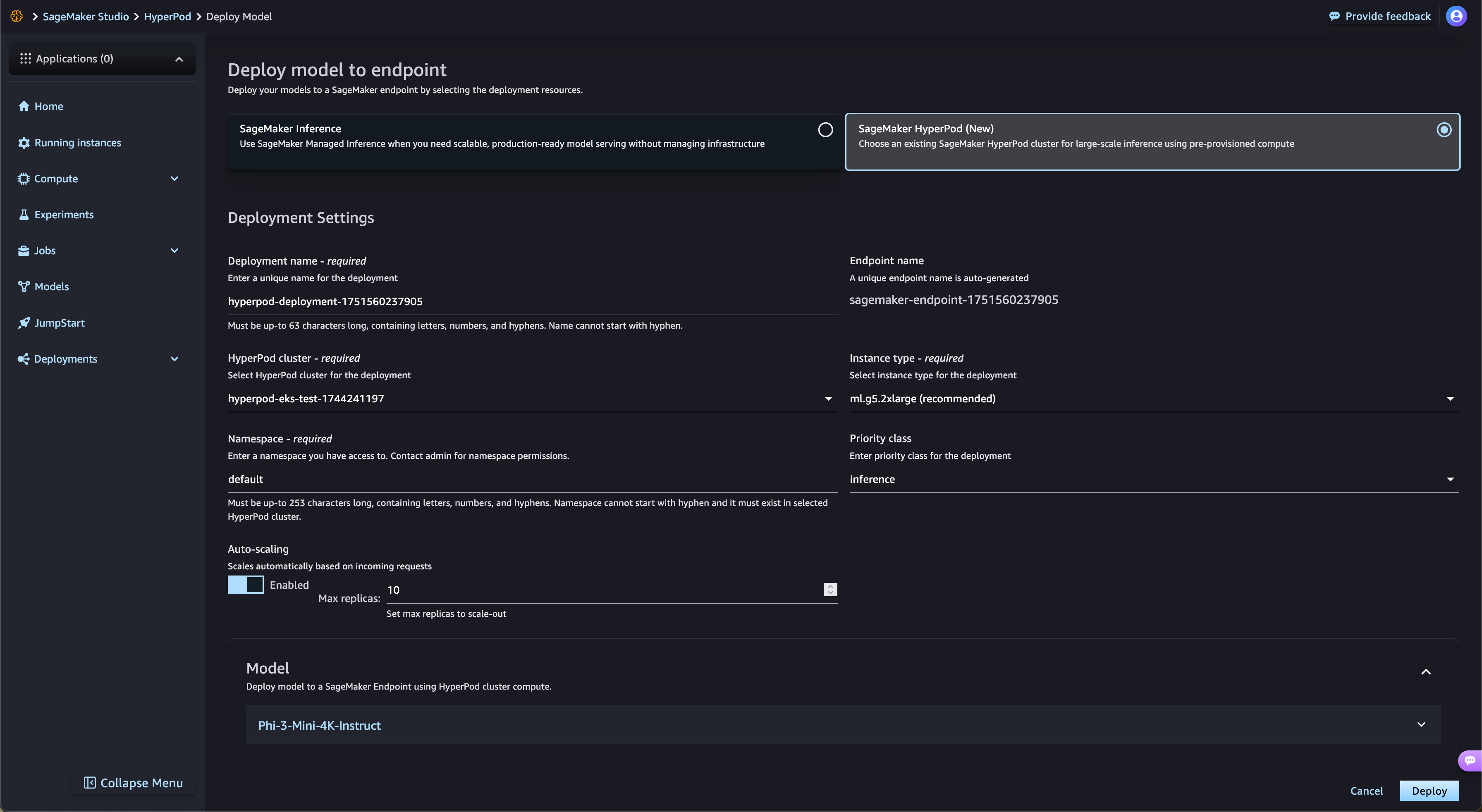

加速从 SageMaker Jumpstart 部署开源权重模型

SageMaker HyperPod 自动简化了 SageMaker JumpStart 的开源权重基础模型部署及来自 S3 和 FSx 的经过微调的模型部署。HyperPod 可自动预置所需的基础设施并设置端点,从而省去了手动预置的步骤。借助 HyperPod 任务治理功能,端点流量将得到持续监控,并能动态调整计算资源,同时还会将全面的性能指标发布到可观测性控制面板上,以便进行实时监控和优化。