Amazon Web Services ブログ

Category: Artificial Intelligence

次世代の Amazon Connect のご紹介: AI を活用し顧客との関係・ビジネス成果を改善

カスタマーエクスペリエンスにおいて AI はより深い顧客関係の構築や売上の向上に役立ちますが、 AI をコンタクトセンターに断片的に導入すると、統合の課題やコスト増加の課題が立ちはだかります。次世代の Amazon Connect では、すべてのチャネルにわたりファーストパーティ AI を提供し、チャネル使用量に基づく料金体系で AI 活用の障壁を取り除きます。このブログ記事では、次世代の Amazon Connect の機能、効果、お客様の声を紹介します。

[開催報告]AWS Summit Japan 2025 生成AIエージェントハッカソン

はじめに 6月25日~26日に開催されたAWS Summit Japan 2025において、「生成AIエージェ […]

株式会社 BTM 様の AWS 生成 AI 活用事例:Amazon Bedrock と Strands Agents を活用したシステム調査の自動化により、調査時間を大幅短縮し運用業務の効率化を実現

本ブログは株式会社 BTM 様と Amazon Web Services Japan 合同会社が共同で執筆いた […]

SDV (ソフトウェア定義車両)向け AUTOSAR 開発を Amazon Q Developer で加速

自動車業界は、車両がメカ主体のシステムから高度なコンピューティングプラットフォームへと進化する中で、大きな変革 […]

AWS サーバレスサービスで実現するラーメン山岡家のキッチンオペレーション効率化

本ブログ記事は、株式会社丸千代山岡家様と AWS Japan が共同執筆したブログです。AWS Summit Japan 2025 での展示内容をもとに、従来の厨房タイマー装置が抱えていた視認性の問題や熟練職人への依存といった課題を、AWS Fargate や Amazon ElastiCache Serverless 、Amazon Bedrock などのサーバレスサービスを活用してどのように解決したかを詳しく解説しています。記事では、導入によりスタッフのスキル習得期間が 500 日から 350 日に短縮され、提供時間も平均 30 秒削減されるなど、具体的な成果を示しながら、外食産業におけるデジタルトランスフォーメーションの実践例として紹介しました。

AWS Weekly Roundup: Kiro、AWS Lambda リモートデバッグ、Amazon ECS ブルー/グリーンデプロイ、Amazon Bedrock AgentCore など (2025 年 7 月 21 日)

7 月 21 日、ホーチミン市からシンガポールに戻る途中に記事を書いています。すばらしい一週間だったと思ってい […]

AWS、AWS Summit New York 2025 にて AI エージェント構築に向けた新たなイノベーションを発表

本記事は米国時間 7 月 16 日に公開された「AWS announces new innovations f […]

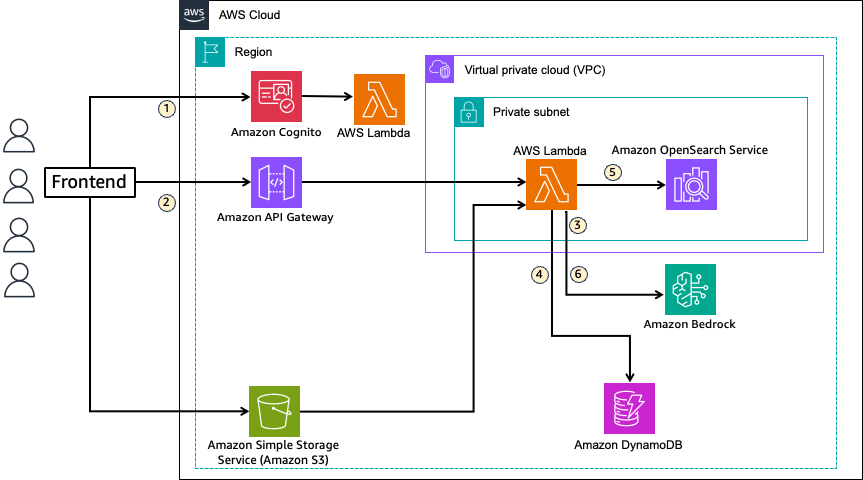

JWT を使用した Amazon Bedrock と Amazon OpenSearch Service による SaaS 向けマルチテナント RAG 実装

本ブログでは、RAG 実装で使用される Vector DB の一つである Amazon OpenSearch Service を例に、JSON Web Token(JWT)と FGAC を組み合わせたテナント分離パターンとテナントリソースへのルーティング方法を紹介します。

【開催報告】Neuron Community – Vol.2

2025年7月15日に開催された「Neuron Community – Vol.2」の様子をレポートします。このイベントは、「Neuron Community」の協力のもと開催しました。Neuron Community は、ユーザー間で AWS Trainium / AWS Inferentia エコシステムに関する情報や知見の共有を促進するための場として発足したものです。今回は、AWS Trainium / AWS Inferentia を実際に利用した経験を共有していただき、さらに Amazon EC2 Inf2 インスタンス上で推論サーバーを立ち上げるハンズオンを実施しました。

詳解: Amazon EKS 超大規模クラスター

本日、Amazon Elastic Kubernetes Service (Amazon EKS) は最大 10 万台のノードをサポートするクラスターの提供を発表しました。Amazon EC2 の新世代高速コンピューティングインスタンスタイプを活用することで、これは単一の Kubernetes クラスターで 160 万個の AWS Trainium チップまたは 80 万個の NVIDIA GPU を実現することを意味します。これにより、最先端のモデルトレーニング、ファインチューニング、エージェント推論などの超大規模人工知能 (AI) および機械学習 (ML) ワークロードが可能になります。